Läser nu: Kali GPT en bekväm hjälp för pentestare

- 01

Kali GPT en bekväm hjälp för pentestare

Kali GPT en bekväm hjälp för pentestare

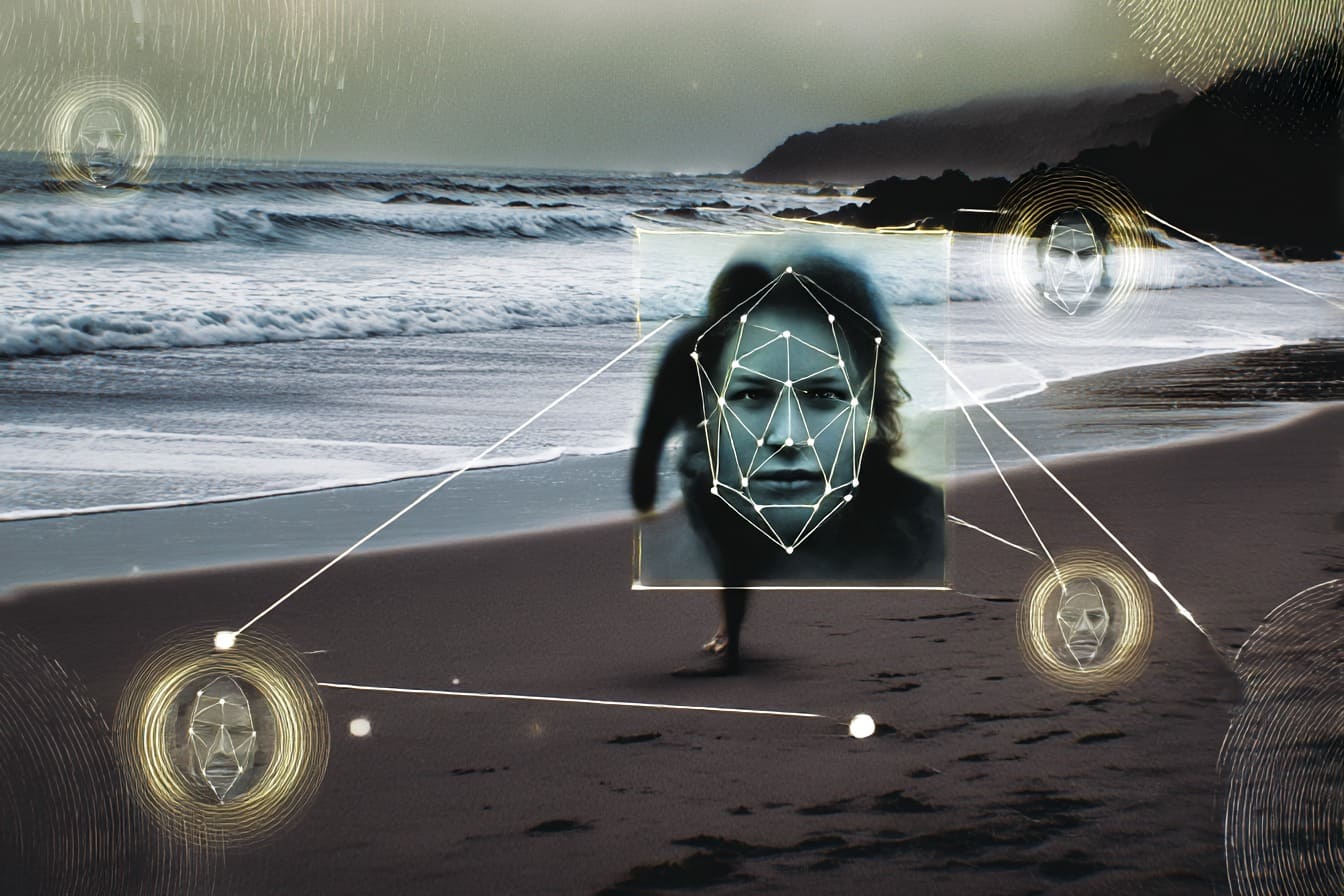

Kali GPT har dundrat in på cybersäkerhetsarenan som en digital sidekick för både nybörjare med drömmar om Matrix och erfarna penetrationstestare som tröttnat på att googla syntaxfel i Metasploit. Det här är en AI-drivna hjälpreda som kan generera kod, förklara exploits och till och med guida dig igenom komplexa attacker som om den vore din egen lilla Mr. Robot. Men vad betyder det egentligen för framtidens hackare, cybersäkerhet och vår eviga katt-och-råtta-lek mellan angripare och försvarare?

Kali GPT byggt på GPT-4

Kali GPT är byggd med OpenAI:s GPT-4 och integrerad direkt i Kali Linux, vilket betyder att den fungerar som ett intelligent gränssnitt mellan dig och hela arsenalen av verktyg i systemet. Nmap, Metasploit, Wireshark? Fråga snällt så berättar den vad som ska göras, hur det ska göras och ibland varför. Det är som att ha en AI-mentor som aldrig tar kaffepaus.

Det är särskilt smidigt för nybörjare – sådana som kanske vet vad en port är, men som fortfarande tror att “sudo” är någon form av pastarätt. Men även för proffsen innebär detta en snabbare, effektivare arbetsdag med mindre fipplande i manualer och mer fokus på strategi.

Hjälpmedel eller krycka?

Det här väcker förstås en större fråga: om AI kan skriva attackkod, föreslå exploits, debugga skript och analysera sårbarheter, vad händer då med den mänskliga faktorn?

På ena sidan av brädet står de glada entusiasterna: AI gör pentestning tillgänglig för fler, effektivare för företagen, och snabbare än någon människa kan googla sig till en lösning. Universiteten jublar – “interaktivt lärande”, säger de, och stoppar in Kali GPT i sina kurser.

På andra sidan? De luttrade säkerhetsexperterna som vet att AI ibland hallucinerar, föreslår exploits som inte finns eller genererar kod som får hela nätverket att tugga bly. AI:n har ingen känsla för konsekvenser. Den bryr sig inte om etik. Den vet inte när “payload” betyder verktyg – eller katastrof.

Mer kunskap, mindre ansvar?

Ett stort problem med AI i cybersäkerhet är att det kan skapa en falsk känsla av kontroll. När Kali GPT föreslår en avancerad reverse shell i Python är det lätt att tänka: “Ja men det låter ju rimligt.” Men vad händer om du inte förstår vad koden faktiskt gör? Om den öppnar en bakdörr, inte bara till målsystemet – utan till dig?

För professionella pentestare innebär det här ett nytt ansvar: att verifiera, validera, och framför allt – ifrågasätta allt AI:n serverar. Det är en balansgång mellan effektivitet och förståelse. AI:n kan bli ett kraftfullt verktyg, men den ska aldrig vara den som håller i ratten helt själv.

Välkommen till framtiden – eller apokalypsen?

Om du är företagare betyder Kali GPT att du kan få snabba, tillförlitliga tester av ditt nätverk utan att behöva anställa en full hacker-armé. Om du är student så betyder det att du får en lärarassistent som faktiskt kan svara på dina frågor klockan tre på natten. Men om du är en svart hatt med dåliga intentioner… tja, AI kommer inte fråga efter dina motiv.

Det betyder att kampen mellan försvar och angrepp nu har fått en ny spelare – en opartisk, allvetande, och stundtals lite galen AI-motor som hjälper vem som helst som vet hur man ställer rätt fråga. Det är inte bara en ny era inom cybersäkerhet – det är en helt ny regelbok.